La somme de n variables aléatoires

- Fiche de cours

- Quiz et exercices

- Vidéos et podcasts

- Étudier la somme et la moyenne de n variables aléatoires indépendantes.

- Étudier les relations entre les espérances et les variances.

- Soit X1 ; X2 ; … ; Xnn variables

aléatoires discrètes et Z = (X1 ; X2 ; … ; Xn).

On considère la variable

aléatoire n-uplets dont l’univers

est noté ΩZ.

On définit la somme de ces n variables aléatoires par S = X1 + X2 + … + Xn dont l’univers est Ωs = {s = x1 + x2 + ⋯ + xn avec (x1 ; x2 ; … ; xn) ΩZ} et

p(S = s) = somme

des p(Z = (x1 ; x2 ; … ; xn)

avec x1 + x2 + ⋯ + xn = s.

ΩZ} et

p(S = s) = somme

des p(Z = (x1 ; x2 ; … ; xn)

avec x1 + x2 + ⋯ + xn = s.

- Soit X1 ;

X2 ;

… ; Xnn variables

aléatoires et S = X1 + X2 + … + Xn.

E(S) = E(X1) + E(X2) + … + E(Xn), soit E(X1 + X2+ … + Xn) = E(X1) + E(X2) + … + E(Xn) - Soit X1 ; X2 ; … ; Xnn variables

aléatoires indépendantes et S = X1 + X2 + … + Xn.

On a V(S) = V(X1) + V(X2) + … + V(Xn), soit V(X1 + X2 + … + Xn) = V(X1) + V(X2) + … + V(Xn). - Soit X une variable aléatoire, un échantillon de taille n de X est un n-uplets de variables aléatoires (X1 ; X2 ; … ; Xn) indépendantes et qui suivent toutes la même loi de X.

- Soit (X1 ; X2 ; … ; Xn) un échantillon de taille n d’une variable aléatoire X et S la somme de cet échantillon : E(S) = nE(X) et V(S) = nV(X).

- Soit X une variable aléatoire qui suit une loi binomiale de paramètres n et p, donc E(X) = np et V(X) = np(1 – p).

- Soit X1 ;

X2 ; … ; Xnn variables

aléatoires et S = X1 + X2 + … + Xn

la somme de ces n variables

aléatoires et

la moyenne de ces

n variables

aléatoires :

la moyenne de ces

n variables

aléatoires :  et

et  .

.

-

E(M) = E(X)

et

.

.

Connaitre les propriétés d’une variable aléatoire.

Soit X1 ; X2 ; … ; Xnn variables aléatoires dont les univers sont notés ΩX1 ; ΩX2 ; … ; ΩXn. La variable aléatoire n-uplets (X1 ; X2 ; … ; Xn), qu’on peut noter Z, est la variable aléatoire dont l’univers est ΩZ = ΩX1 × ΩX2 × … × ΩXn et telle que :

p(Z = (x1 ; x2 ;

… ; xn) = p((X1 = x1) ![]() (X2 = x2)

(X2 = x2) ![]() …

… ![]() (Xn = xn)).

(Xn = xn)).

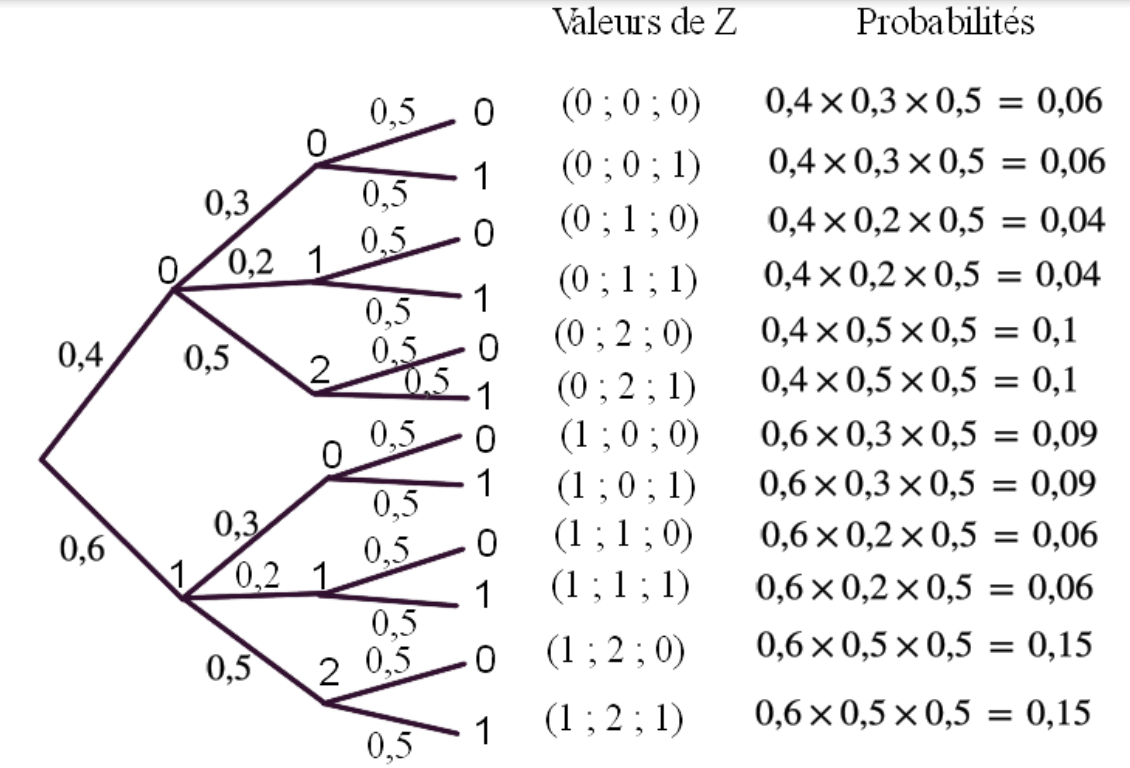

On considère trois urnes contenant des jetons numérotés. La première urne contient 5 jetons (2 jetons numérotés 0 et 3 jetons numérotés 1), la deuxième urne contient 10 jetons (3 jetons numérotés 0, 2 jetons numérotés 1 et 5 jetons numérotés 2) et la troisième urne contient 2 jetons (1 jeton numéroté 0 et l’autre numéroté 1).

On tire au hasard un jeton dans la première urne et on note X1 le numéro du jeton tiré. Puis on tire au hasard un jeton dans la deuxième urne et on note X2 le numéro du jeton tiré. Enfin on tire au hasard un jeton dans la troisième urne et on note X3 le numéro du jeton tiré.

On va déterminer la loi de la variable aléatoire Z = (X1 ; X2 ; X3).

Traduisons cette situation par un arbre pondéré.

Soit X1 ; X2 ; … ; Xn n variables aléatoires discrètes et Z = (X1 ; X2 ; … ; Xn). On considère la variable aléatoire n-uplets dont l’univers est noté ΩZ.

On définit la somme de ces n variables aléatoires par S = X1 + X2 + … + Xn dont l’univers est :

ΩS = {s = x1 + x2 + ⋯ + xn avec (x1 ; x2 ; … ; xn)et p(S = s) = somme des p(Z = (x1 ; x2 ; … ; xn) avec x1 + x2 + ⋯ + xn = s.

Reprenons l’exemple précédent.

On a ΩX1 = {0 ; 1} ; ΩX2 = {0 ; 1 ; 2} et ΩX3 = {0 ; 1}, donc les valeurs possibles de S = X1 + X2 + X3 sont :

| Valeurs de Z | Valeurs de S |

| (0 ; 0 ; 0) | 0 |

| (0 ; 0 ; 1) | 1 |

| (0 ; 1 ; 0) | 1 |

| (0 ; 1 ; 1) | 2 |

| (0 ; 2 ; 0) | 2 |

| (0 ; 2 ; 1) | 3 |

| (1 ; 0 ; 0) | 1 |

| (1 ; 0 ; 1) | 2 |

| (1 ; 1 ; 0) | 2 |

| (1 ; 1 ; 1) | 3 |

| (1 ; 2 ; 0) | 3 |

| (1 ; 2 ; 1) | 4 |

Donc ΩS = {0 ; 1 ; 2 ; 3 ; 4}.

p(S = 0) = p(Z = (0 ; 0 ; 0) = 0,06

p(S = 1) = p(Z = (0 ; 0

; 1)) + p(Z = (0 ; 1 ; 0))

+ p(Z = (1 ; 0 ; 0))

p(S = 1) = 0,06 + 0,04 + 0,09 = 0,19

p(S = 2) = p(Z = (0 ; 1 ; 1))

+ p(Z = (0 ; 2 ; 0))

+ p(Z = (1 ; 0 ; 1))

+ p(Z = (1 ; 1 ; 0))

p(S = 2) = 0,04 + 0,1 + 0,09 + 0,06 = 0,29

p(S = 3) = p(Z = (0 ; 2 ; 1)) + p(Z = (1 ; 1 ; 1)) + p(Z = (1 ; 2 ; 0)) = 0,1 + 0,06 + 0,15 = 0,31

p(S = 4) = p(Z = (1 ; 2 ; 1)) = 0,15

Donc la loi de S est :

| si | 0 | 1 | 2 | 3 | 4 |

| pi = p(S = si) | 0,06 | 0,19 | 0,29 | 0,31 | 0,15 |

Pour deux variables aléatoires X et Y, l’espérance de la somme de X et Y est égale à la somme des espérances de X et Y, soit E(X + Y) = E(X) + E(Y). Ceci se généralise à une somme de n variables aléatoires.

Soit X1 ; X2 ; … ; Xnn variables aléatoires et S = X1 + X2+ … + Xn.

E(S) = E(X1) + E(X2) + … + E(Xn)

Soit E(X1 + X2+ … + Xn) = E(X1) + E(X2) + … + E(Xn)Reprenons l’exemple précédent :

- Espérance de X1

| Valeurs de X1 | x11 = 0 | x12 = 1 |

| Probabilités | p11 = 0,4 | p12 = 0,6 |

E(X1) = p11x11+ p12x12 = 0,4 × 0 + 0,6 × 1 = 0,6

- Espérance de X2

| Valeurs de X2 | x21 = 0 | x22= 1 | x23= 2 |

| Probabilités | p21 = 0,3 | p22= 0,2 | p23= 0,5 |

E(X2) = p21x21+ p22x22+ p23x23= 0,3 × 0 + 0,2 × 1 + 0,5 × 2 = 1,2

- Espérance de X3

| Valeurs de X3 | x31 = 0 | x32= 1 |

| Probabilités | p31 = 0,5 | p32= 0,5 |

E(X3) = p31x31 + p32x32= 0,5 × 0 + 0,5 × 1 = 0,5

- Espérance de S = X1 + X2 + X3

| si | 0 | 1 | 2 | 3 | 4 |

| pi = p(S = si) | 0,06 | 0,19 | 0,29 | 0,31 | 0,15 |

E(S) = p1s1 + p2s2 + p3s3 + p4s4 + p5s5

E(S) = 0,06 × 0 + 0,19

× 1 + 0,29

× 2 + 0,31

× 3 + 0,15 × 4 = 2,3

Et on a E(X1) + E(X2) + E(X3) = 0,6 + 1,2 + 0,5 = 2,3.

On a bien E(S) = E(X1) + E(X2) + E(X3),soit E(X1+ X2+ X3) = E(X1) + E(X2) + E(X3).

Des variables aléatoires sont indépendantes si elles sont de situations indépendantes, c’est-à-dire :

P((X1 = x1)![]() (X2 = x2)

(X2 = x2) ![]() …

… ![]() (Xn = xn))

(Xn = xn))

=

P(X = x1) × P(X = x2) × … × P(X = xn)

pour tout xi ![]() ΩXi

ΩXi

Si X et Y sont deux variables aléatoires indépendantes, la variance de la somme de X et Y est égale à la somme des variances de X et Y, soit V(X + Y) = V(X) + V(Y). Ceci se généralise pour la somme de n variables aléatoires indépendantes.

Soit X1 ; X2 ; … ; Xnn variables aléatoires indépendantes et S = X1 + X2 + … + Xn.

V(S) = V(X1) + V(X2) + … + V(Xn)

Reprenons l’exemple précédent.

X1, X2 et X3 sont issues de trois situations indépendantes, donc X1, X2 et X3 sont indépendantes.

V(X1) = p11(x11 – E(X1))2 + p12(x12 – E(X1))2

V(X1) = 0,4

× (0 – 0,6)2 + 0,6

× (1 – 0,6)2 = 0,24

V(X2)

= p21(x21 – E(X2))2 + p22(x22 – E(X2))2 + p23(x23 – E(X2))2

V(X2) = 0,3 × (0 – 1,2)2 + 0,2

× (1 – 1,2)2 + 0,5

× (2 – 1,2)2 = 0,76

V(X3) = p31(x31 – E(X3))2 + p32(x32 – E(X3))2

V(X3) = 0,5

× (0 – 0,5)2 + 0,5

× (1 – 0,5)2 = 0,25

V(S) = p1(s1 – E(S))2 + p2(s2 – E(S))2 + … + p5(s5 – E(S))2

V(S) = 0,6

× (0 – 2,3)2 + 0,19

× (1 – 2,6)2 + … + 0,15

× (4 – 2,3)2 = 1,25

Donc V(S) = V(X1) + V(X2) + V(X3),

soit V(X1+ X2+ X3) = V(X1) + V(X2) + V(X3).

Dans une urne de 10 jetons, 3 jetons sont numérotés 0, 5 jetons numérotés 1 et 2 jetons numérotés 2.

On tire au hasard un jeton, on note son numéro et on note X le numéro tiré.

La loi de X est :

| xi | 0 | 1 | 2 |

| pi = p(X = xi) | 0,3 | 0,5 | 0,2 |

X1, X2 et X3 sont indépendantes, puisqu’on remet le jeton dans l’urne après chaque tirage. Les lois de X1, de X2 et de X3 sont les mêmes que celle de X.

Donc (X1 ; X2 ; X3) est un échantillon de taille 3 de X.

Soit (X1 ; X2 ; … ; Xn) un échantillon de taille n d’une variable aléatoire X et S la somme de cet échantillon :

E(S) = nE(X)

- Soit (X1 ;

X2 ;

… ; Xn) un

échantillon de taille n d’une variable

aléatoire X et S la somme de cet

échantillon, c’est-à-dire

S = X1 + X2 + … + Xn.

E(S) = E(X1 + X2 + ⋯ + Xn) = E(X1) + E(X2) + ⋯ + E(Xn)

Comme X1 ; X2 ; … ; Xn suivent la même loi que celle de X, donc :

E(X1) = E(X2) = … = E(Xn) = E(X) et E(S) = E(X) + E(X) + ⋯+ E(X) avec n facteurs

D’où E(S) = nE(X).

- De même, et puisque les Xi sont

indépendantes :

V(S) = V(X1 + X2 + ⋯ + Xn) = V(X1) + V(X2) + ⋯ + V(Xn)

Comme X1 ; X2 ; … ; Xn suivent la même loi que celle de X, donc :

V(X1) = V(X2) = … = V(Xn) = V(X) et V(S) = V(X) + V(X) + ⋯ + V(X) avec n facteurs

D’où V(S) = nV(X).

Soit X la variable aléatoire qui suit une loi de Bernoulli de paramètre p = 0,4.

On sait que E(X) = p = 0,4 et V(X) = p(1 – p) = 0,4 × 0,6 = 0,24.

S étant la somme d’un échantillon de X de taille 100, donc :

E(S) = nE(X) = 100 × 0,4 = 40

V(S) = 100 × 0,24 = 24Soit X une variable aléatoire qui suit une loi binomiale de paramètres n et p donc :

E(X) = np

Soit X une variable aléatoire qui suit une loi binomiale de paramètres n et p. n est le nombre de répétitions et p la probabilité du succès.

Comme une loi binomiale est une somme de lois de Bernoulli, c’est-à-dire une somme d’un échantillon d’une variable aléatoire qui suit la loi de Bernoulli de paramètre p, alors X = X1 + X2+ … + Xn, avec X1 ; X2 ; … ; Xn des variables aléatoires qui suivent la même loi de Bernoulli de paramètre p.

Donc E(X) = E(X1 + X2+ …

+ Xn) = E(X1) + E(X2) + ⋯ + E(Xn)

E(X) = p + p + ⋯ + p

avec n facteurs

E(X) = np

V(X) = V(X1 + X2 + ⋯ + Xn) = V(X1) + V(X2) + ⋯ + V(Xn)

V(X) = p(1 – p) + p(1 – p) + ⋯ + p(1 – p)

avec n facteurs

V(X) = np(1 – p)

On retrouve ainsi l’espérance et la variance d’une loi binomiale.

Soit a un nombre réel et X une variable aléatoire :

E(aX) = aE(X)

Reprenons l’exemple du paragraphe I.

On reprend la loi de S = X1 + X2 + X3.

| si | 0 | 1 | 2 | 3 | 4 |

| pi = p(S = si) | 0,06 | 0,19 | 0,29 | 0,31 | 0,15 |

Donc la loi de M = ![]() est :

est :

| mi | 0 |

|

|

1 |

|

| pi = p(M = mi) | 0,06 | 0,19 | 0,29 | 0,31 | 0,15 |

Soit X1 ; X2 ; … ; Xnn variables aléatoires et S = X1 + X2 + ⋯ + Xn la somme de ces n variables aléatoires et M =

E(M) = ![]() .

.

M = ![]()

M = ![]() avec

S = X1 + X2 + ⋯ + Xn

avec

S = X1 + X2 + ⋯ + Xn

M = ![]() S

S

E(M) = E![]()

E(M) = ![]() E(S)

E(S)

On reprend l’exemple précédent. On avait calculé E(S) = 2,3.

E(M) = p1m1+ p2m2+ p3m3+ p4m4+ p5m5

E(M) = 0 × 0,06

+ ![]() × 0,19

+

× 0,19

+ ![]() × 0,29

+ 1

× 0,31

+

× 0,29

+ 1

× 0,31

+ ![]() × 0,15

× 0,15

E(M) = ![]()

![]() =

= ![]() =

= ![]()

Soit X1 ; X2 ; … ; Xnn variables aléatoires indépendantes et S = X1 + X2 + ⋯ + Xn la somme de ces n variables aléatoires et M =

M = ![]() S

S

V(M) = V![]()

V(M) = ![]() V(S)

V(S)

V(M) = ![]() V(S)

V(S)

On reprend l’exemple précédent. On avait calculé V(S) = 1,25.

V(M) = p1(m1 – E(M))2+ p2(m2 – E(M))2+ ⋯ + p5(m5 – E(M))2

V(M) = 0,06 × (0 – 2,3)2+ 0,19

× (![]() – 2,3)2+ ⋯

+ 0,15

× (

– 2,3)2+ ⋯

+ 0,15

× (![]() – 2,3)2

– 2,3)2

V(M) = ![]()

![]() =

= ![]() =

= ![]()

Soit X une variable aléatoire et M la moyenne d’un échantillon de taille n de X, donc :

Soit X une variable aléatoire et (X1 ; X2 ; … ; Xn) un échantillon de taille n de cette variable aléatoire et S la somme des Xi.

M = ![]()

E(M) = ![]() et V(M) =

et V(M) = ![]()

Or, pour un échantillon de taille n de X, on a :

E(S) = nE(X) et V(S) = nV(X)

Donc E(M) = ![]() = E(X) et V(M) =

= E(X) et V(M) = ![]() =

= ![]() .

.

Soit X une variable aléatoire qui suit une loi de Bernoulli de paramètre p :

E(X) = p et V(X) = p(1 – p).

M étant la moyenne d’un échantillon de taille n de X, donc :

E(M) = p et V(X) =

Des quiz et exercices pour mieux assimiler sa leçon

La plateforme de soutien scolaire en ligne myMaxicours propose des quiz et exercices en accompagnement de chaque fiche de cours. Les exercices permettent de vérifier si la leçon est bien comprise ou s’il reste encore des notions à revoir.

Des exercices variés pour ne pas s’ennuyer

Les exercices se déclinent sous toutes leurs formes sur myMaxicours ! Selon la matière et la classe étudiées, retrouvez des dictées, des mots à relier ou encore des phrases à compléter, mais aussi des textes à trous et bien d’autres formats !

Dans les classes de primaire, l’accent est mis sur des exercices illustrés très ludiques pour motiver les plus jeunes.

Des quiz pour une évaluation en direct

Les quiz et exercices permettent d’avoir un retour immédiat sur la bonne compréhension du cours. Une fois toutes les réponses communiquées, le résultat s’affiche à l’écran et permet à l’élève de se situer immédiatement.

myMaxicours offre des solutions efficaces de révision grâce aux fiches de cours et aux exercices associés. L’élève se rassure pour le prochain examen en testant ses connaissances au préalable.

Des vidéos et des podcasts pour apprendre différemment

Certains élèves ont une mémoire visuelle quand d’autres ont plutôt une mémoire auditive. myMaxicours s’adapte à tous les enfants et adolescents pour leur proposer un apprentissage serein et efficace.

Découvrez de nombreuses vidéos et podcasts en complément des fiches de cours et des exercices pour une année scolaire au top !

Des podcasts pour les révisions

La plateforme de soutien scolaire en ligne myMaxicours propose des podcasts de révision pour toutes les classes à examen : troisième, première et terminale.

Les ados peuvent écouter les différents cours afin de mieux les mémoriser en préparation de leurs examens. Des fiches de cours de différentes matières sont disponibles en podcasts ainsi qu’une préparation au grand oral avec de nombreux conseils pratiques.

Des vidéos de cours pour comprendre en image

Des vidéos de cours illustrent les notions principales à retenir et complètent les fiches de cours. De quoi réviser sa prochaine évaluation ou son prochain examen en toute confiance !